Vale la pena di spendere una frase per fare una precisazione terminologica e segnalare la differenza tra intelligenza artificiale analitica e generativa. La prima si occupa, come indica il nome, di processare vastissime raccolte di dati per estrapolare schemi e tendenze, ha un’impronta energetica relativamente contenuta, e ha già dimostrato di avere utili applicazioni pratiche in vari campi, tra cui, tanto per fare un solo esempio, quello della medicina, dove un algoritmo di IA inizialmente sviluppato per facilitare il riconoscimento automatico dei prodotti del reparto pasticceria dei supermercati giapponesi ha rivelato un’accuratezza del 98% nel riconoscimento delle cellule tumorali negli stadi iniziali di varie forme di cancro.2 La seconda, al contrario, si occupa di produrre oggetti verbali o visivi nuovi a partire dalla scomposizione e ricomposizione di mastodontici repertori di dati, sottratti attraverso la procedura di scraping dall’intero continente di internet (e non solo), e ha un impatto ambientale devastante per consumo di energia e soprattutto di acqua.3 Promossa ossessivamente dall’intero settore Big Tech negli ultimi dodici mesi, inserita a forza in quasi tutte le applicazioni e i programmi di uso comune, l’IA generativa è diventata l’investimento di punta delle corporation tecnologiche e la risorsa più o meno ingenuamente usata da una massa sempre più vasta di utenti, inclusi i membri della comunità universitaria, studenti, ricercatori e docenti.

Lasciando a spazi più appropriati la discussione delle implicazioni etiche (in aggiunta al furto di massa di pubblicazioni e opere d’arte protette da copyright, di vari ordini di grandezza più vasto del download di articoli da Jstor per il quale il ricercatore di Harvard Aaron Swartz fu condannato a cinquant’anni di carcere e un milione di dollari di multa nel 2011, sentenza che l’ha portato al suicidio,4 gli enormi data center necessari al funzionamento di IA generative sono spesso collocati, per evitare la corrosione dei circuiti provocata dall’umidità, nelle aree aride di regioni spesso povere, alle quali sottraggono mostruose quantità di acqua per immetterle nei sistemi raffreddamento dei processori, contaminandole irreversibilmente con metalli pesanti) e delle disastrose conseguenze cognitive (tra cui il deterioramento, spaventosamente rapido, delle capacità di pensiero e memoria degli utenti che fanno uso sistematico di IA per la scrittura o la sintesi di testi, come recentemente rilevato da uno studio del MIT),5 c’è una questione di ordine culturale e politico a cui è importante prestare attenzione.

Le intelligenze artificiali generative sono attualmente proposte (o sarebbe più corretto dire imposte, visto il loro unilaterale e quasi universale inserimento forzato in molte applicazioni di uso comune) come funzionalità aggiuntive divertenti, stimolanti, utili e soprattutto innocue. Addirittura, in alcuni casi la loro promozione si appropria delle battaglie per l’accessibilità, con la pretesa di essere la risposta a problemi che le persone con varie disabilità soffrirebbero nel confronto quotidiano con la scrittura, la lettura, o la produzione di immagini. Ma non è un caso che gli sviluppatori di questi strumenti facciano organicamente parte di quello stesso blocco di potere neoliberista, ipercapitalista, regressivo e antiliberale (quando non apertamente fascista) che negli ultimi anni ha più o meno rapidamente preso il potere in diverse nazioni spingendo l’Occidente in una condizione di inequivocabile regressione democratica.

Le IA in questo senso sono solo l’estrema avanguardia di quell’ondata di anti-intellettualismo che ha condotto i nostri anni nella palude della post verità, della cospirazione, dell’adesione, paradossale e grottesca, delle classi lavoratrici all’ideologia del miliardario trionfante, con conseguente involuzione del conflitto sociale in guerra tra poveri e difesa compulsiva delle classi dominanti e delle loro logiche di sfruttamento.

Non è una novità: le professioni intellettuali e artistiche tendono a costituire baluardi di resistenza al fascismo, per la loro capacità di addestrare la mente alla complessità, alla verifica critica e all’empatia umana che sono proprio le caratteristiche di cui tutti i fascismi tendono a liberarsi per poter imporre le loro retoriche semplificate, dogmatiche e repressive. E non è una sorpresa che in questo clima sia esplosa la volontà di creare “intellettuali” e “artisti” sintetici che il potere anti-intellettualista può tenere nel palmo della propria mano, riducendoli a macchine sputa-risposte che possono essere programmate per aderire a qualunque bias più o meno nascosto, e che parlano solo quando interrogate, radicalmente incapaci di esprimere pensieri autonomi e assoldate in un processo di distruzione di massa delle capacità cognitive cruciali per il sistema immunitario di ogni democrazia.

Far stendere un abstract con ChatGPT, far prendere appunti da Gemini, o far produrre un disegno da Midjourney possono sembrare insignificanti esercizi della propria libertà di servirsi di strumenti per alleggerire il proprio carico di lavoro, ma, oltre la banale verità che nessuno strumento è mai politicamente neutro, in questo caso il passaggio logico saltato è che al cuore del mestiere di chi studia, scrive, o crea opere d’arte non c’è la produzione più facile e indolore possibile di un certo risultato, ma proprio il processo che porta allo sviluppo delle capacità per ottenerlo, nel quale si esprimono le abilità intrinsecamente umane e non replicabili degli individui. E questo è tanto più grave quando colpisce i giovani studenti e studiosi che si trovano ancora nelle prime fasi dei loro percorsi formativi.

Le intelligenze artificiali sono lo strumento che permette di sabotare il tempo della formazione dei giovani, “tentandoli” con l’esca della facile risposta a tutte quelle verifiche che richiederebbero un percorso di faticosa crescita, e facendo in modo che quel prezioso momento della vita dedicato alla conquista e all’affinamento delle conoscenze e delle capacità venga svalutato agli occhi degli stessi giovani che dovrebbero beneficiarne. E una volta svalutato, è tanto più facile poter poi convertirlo in obblighi di lavoro (ovviamente non qualificato), o aggredirlo direttamente con attacchi al diritto all’istruzione, che di recente ha raggiunto le punte grottesche dello sdoganamento del lavoro minorile negli Stati Uniti (ma a nostra volta abbiamo sperimentato una versione minor dello stesso progetto nella cosiddetta “alternanza scuola-lavoro” promossa dal governo Renzi).

Un discorso a parte andrebbe poi fatto sulla “retorica della pigrizia” brandita come arma del capitalismo, che cerca di massimizzare il tempo del lavoro imposto alle classi lavoratrici promuovendo una “cultura” del lavoro permanente, in cui ogni momento di formazione personale, di socializzazione, di riposo e di svago viene moralmente criminalizzato per favorire un distopico ideale di vita senza riposo, senza otium, semplicemente incompatibili con il mantenimento di una esistenza fisicamente e mentalmente sana. A che scopo “sprecare” il proprio tempo per studiare e scrivere un saggio, o per allenarsi a dipingere un acquerello, quando si può delegare queste attività a un programma che può completarle istantaneamente, lasciandoci “liberi” (!) di impiegare le nostre energie e le nostre giornate alla produttività di cui beneficia il sistema politico-economico del capitalismo contemporaneo?

L’esplosione delle intelligenze artificiali è oggi un tema strano da trattare: da un lato, chi cerca di seguire il discorso con consapevolezza critica viene guardato come un troglodita neoluddista che si oppone al progresso della storia, dall’altro, l’esistenza stessa di questi strumenti oscilla tra un senso di apocalittica inevitabilità («sono qui per restare», «è troppo tardi», ecc.) e una rassicurante impressione di fragilità, da bolla sul punto di scoppiare per la pressione dei suoi stessi criteri (di profitto, ovviamente: le rese degli investimenti mastodontici che si sono riversati su questo settore non sembrano soddisfare le aspettative, e ogni tentativo di sistematica ricognizione dell’effettiva efficacia di questi mezzi ha dato risposte che lasciano a desiderare, come risulta dal fatto che «despite $30-40 billion in enterprise investment into GenAI, […] 95 per cent of organisations are getting zero return»).6 L’evoluzione di questo stato di cose è difficile da prevedere, ma è di fondamentale importanza mantenere la lucidità sul quadro generale di attacco sistematico alle professioni intellettuali e artistiche che fa da sfondo all’invasione di questi non innocui supporti digitali.

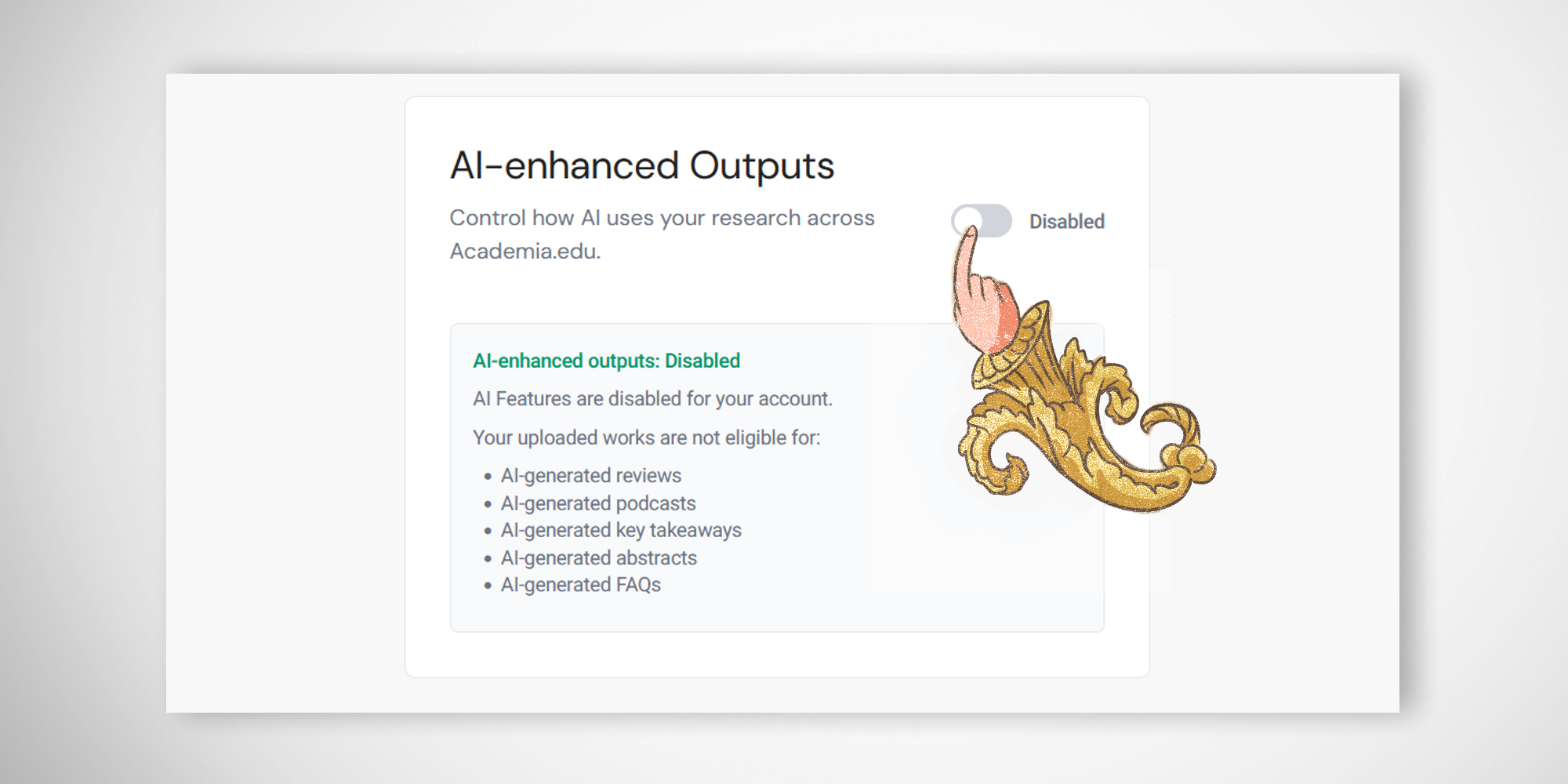

E mentre scrivo, Academia mi informa che, a mia insaputa e senza il mio consenso, un podcast auto-generato di uno dei miei saggi è appena diventato disponibile sulla mia pagina personale.

1 G. Lukács, Essenza e forma del saggio. Una lettera a Leo Popper, in Id., L’anima e le forme, trad. it. di S. Bologna, Milano, SE, 2002, p. 22. Cfr. T.W. Adorno, Il saggio come forma, in Id., Note per la letteratura, ed. it a cura di S. Givone, Torino, Einaudi, 2012.

2 M. Andrei, The unlikely story of how a pastry AI came to be used to detect cancer, in «ZME Science», October 16, 2024.

3 A. Zewe, Explained: Generative AI’s environmental impact, in «MIT News», January 17, 2025.

4 Meta, la compagnia madre di social network come Facebook, Instagram e Whatsapp, ha recentemente ammesso di aver addestrato la propria IA generativa piratando sette milioni e mezzo di libri dalla piattaforma LibGen (A. Reisner, Search LibGen, the Pirated-Books Database That Meta Used to Train AI, in «The Atlantic», March 20, 2025). La vicenda di Aaron Swartz è stata coperta da numerose testate ed è considerata oggi un momento cruciale della storia dell’attivismo per la cultura open source: vd. tra gli altri R. Singel, Feds Charge Activist as Hacker for Downloading Millions of Academic Articles, in «Wired», July 19, 2011, e G. Ziccardi, Internet bene comune: a 10 anni dalla morte, la battaglia di Aaron Swartz è più importante che mai, in «wired», 11 gennaio 2023.

5 N. Kosmyna et al., Your brain on chatgpt: Accumulation of cognitive debt when using an ai assistant for essay writing task, in «MIT Media Lab», June 10, 2025.

6 A. Challapally et al., The GenAI Divide. State of AI in Business 2025, in «MIT Nanda», July 2025; cfr. A. Dina, Intelligenza Artificiale e capitale: la nuova bolla dorata dell’economia digitale, in «Rivista AI», 22 agosto 2025.